近年来,人工智能技术进步神速,从语言处理到图像生成、各类的应用范围越来越广,同时也彻底改变了我们的生活和工作方式。然而,AI 的快速发展也带来了对计算能力前所未有的需求、传统硬体的效能提升已趋缓,摩尔定律带来的晶体管密度红利逐渐触顶,处理器频率受限于功耗与散热瓶颈,就连GPU 的成长速度也明显放慢。 AI 对算力的需求呈指数式暴增,到了难以持续的地步。

于是,大家开始把目光转向量子电脑,期待它能突破传统运算极限,为AI 带来飞跃性成长。

AI 的现况与算力瓶颈

许多人已经让AI 融入他们的工作:例如OpenAI 的ChatGPT 协助分析与文书、或是像有些人会使用Cursor 或是Claude 协助撰写程式、还有无数的AI 应用可以生成图片或影片互动。这些技术的背后核心是大型语言模型(LLM)、以大量资料为基础训练而成。以OpenAI 的GPT-3 为例,训练过程估计需要执行3.14×10²³ 次浮点运算,是人类史上最复杂的计算任务之一(只是之一,以后只会更恐怖)。这种惊人算力需求让科技公司不得不投入巨资在云端GPU 和TPU 上,有些新创公司甚至花费超过八成经费在运算资源。

即便有像DeepSeek 这种节省资源的AI,算力瓶颈仍在──DeepSeek 这类技术,通常是透过演算法最佳化或模型压缩降低算力需求。比方说,它可能用稀疏化(sparsity)让模型只启动部分参数,或者用知识蒸馏(knowledge distillation)把大模型的知识「浓缩」到小模型里。根据DeepSeek 官方说法,他们的模型能在保证性能的情况下,把计算成本降到传统模型的几分之一。

举例来说,DeepSeek 就像把一台吃油超跑改成了省油小车,确实能在一定程度上缓解算力压力。假设原本训练一个大模型需要1,000 万美元的云端算力,DeepSeek 的技术可能把成本砍到300 万美元,还能保持八成以上的准确度。这种节省算法对中小企业或研究团队来说是福音,因为他们不用砸大钱也能玩AI。但问题在于,这只是「减轻」瓶颈,不是「解决」瓶颈。为什么呢?因为AI 应用的野心和复杂度也在同步成长。

AI 的应用场景越来越广,从聊天机器人到自动驾驶,再到医疗诊断,每个领域都想把模型做得更强、更精准。以自动驾驶为例,特斯拉的AI 系统得即时处理摄影机、雷达传来的大量资料,还要预测路况,算力需求轻易就超过一般云端伺服器的负担。即便DeepSeek 能把模型压缩,这些应用还是需要处理更多资料、更复杂的运算,省下的算力很快又被新需求吃掉。

另外一方面,传统硬体的效能成长正在趋缓。摩尔定律带来的晶体管密度提升已接近极限,处理器频率受功耗与散热限制,连GPU 的效能成长也开始趋缓。研究显示,为了提高AI 模型的准确度,往往只能靠增加算力和扩大模型规模来实现,这导致AI 对计算资源的需求呈指数式暴增,已到难以承受的地步。虽然硬体加速和演算法优化能稍微缓解压力,但AI 发展正面临前所未有的算力瓶颈。于是,量子电脑被视为潜在解方,期望其突破传统运算限制,为AI 开辟新天地。

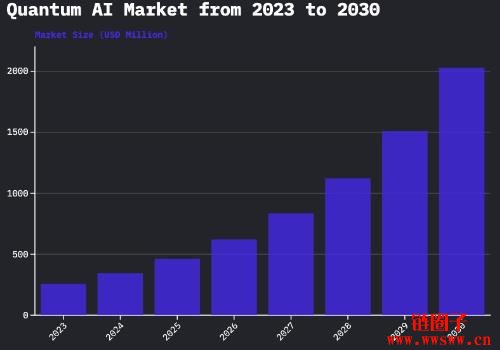

▲ 量子AI 市场主要是以研发为主,没有商业应用。 (Source:artsmart)

量子电脑如何为AI 加持

量子电脑与传统电脑的运作方式截然不同。传统电脑用位元(bit)表示0 或1,量子电脑则用量子位元(qubit),能透过叠加(superposition)同时处于0 和1 的状态。例如,两个量子位元可同时处理四种状态组合,三个则是八种,n 个量子位元能表示2ⁿ 种状态,这种指数级扩张赋予量子电脑强大的并行计算潜力。此外,量子纠缠(entanglement)让多个量子位元的状态紧密相连,测量其一会立即影响其他量子,增强了协同运算能力。

这种特性对AI 有何帮助? Google 量子AI 实验室创办人Hartmut Neven 曾说:「先进AI 将从量子运算中大幅受益。」以训练大型语言模型为例,这类任务需要庞大时间和算力,量子电脑的并行处理能力可能将训练时间从数周缩至数天。此外,AI 主要依赖找出模式并辨识,而能同时处理多种可能性的量子运算,或许能提升图像、语音识别的准确度。生成式AI 也有望因量子助力处理更多资料,生成更逼真的内容。在决策场景中,例如药物研发或气候建模,量子电脑能同时测试无数变数,帮助科学家更快找到最佳解。

例如2019 年,Google 的53 量子位元「Sycamore」处理器在200 秒内完成传统超级电脑需1 万年的任务。虽然这与AI 无直接关联,但展示了量子运算的潜力。 2022 年,维也纳大学团队用光子量子处理器加速强化学习,让机器人更快学会走迷宫,证明量子叠加能提升学习效率。

当前进展与初步成果

由于大型容错量子电脑尚未临近,各方多预测短期内最可行的模式是「混合量子经典计算」,即将大部分深度学习的训练与资料处理交由GPU / CPU 完成,只有小部分最耗算力或最能发挥量子优势的子任务交由量子处理器(QPU)加速。 Google、IBM 亦在研发量子软硬体协同架构,如TensorFlow Quantum 或Qiskit Runtime,让开发者调用云端量子资源。 Nvidia GTC Quantum Day 也特别提到,市场期待未来GPU 与QPU 共同承担深度神经网路或强化学习的运算──尽管目前的量子位元规模只有几十至数百个,但若能针对组合优化、线性代数等环节实现加速,各类包括医疗、金融、物流、国防应用都可能抢先受益。

医疗方面,量子模拟可大幅加速分子与蛋白质交互作用的分析,有助新药研发与疾病机理理解。 「维也纳大学」的研究团队在2022 年曾用光子量子处理器测试量子强化学习,让机器人同时探索多条路径,更快学会迷宫走法,被视为量子叠加有助于复杂决策的证明。金融市场关注量子电脑能以指数方式优化蒙地卡罗模拟、投资组合配置、期权定价与诈骗侦测。美国与欧洲多家金融机构正在评估量子近似最佳化演算法(QAOA)的可行性,若能大规模部署,将重新定义高维度交易环境的风险管理流程。

波音的量子感测器试验展现超精准导航潜力、量子模拟可能将新药开发周期从15 年缩至五年;金融领域,量子蒙地卡罗演算法能快速评估市场情境、提升风险管理效率。这些进展显示量子AI 运算正在进行更多测试,虽然许多应用都已经现有的AI 能处理的问题,但量子AI 可以加速或将这些应用变得更强大。 Google 的Willow 计画在量子位元技术与错误修正取得进展,全球量子技术投资2023 年已超过300 亿美元,且十年内加速成长。

产业应用的可行性:医疗、金融、能源与军事

军事与国防,量子加密与量子解密为关键。量子技术若能破解现今广泛使用的RSA 或ECC 加密,势将造成全球通讯与网路金融体系的重大冲击。据「Quantum Apocalypse Is Coming. Be Very Afraid」一文所述,人们将Q-Day 定义为量子电脑能即刻破解既有加密系统的那一天,而这在地缘政治层面将引发严重后果。若某个国家率先完成可用于军事情报分析或密码破解的量子装置,恐造成世界秩序洗牌。美中双方皆积极布局量子通讯卫星与量子感测器,美国更有《国家量子倡议法案》提供大笔资金,也对中国量子企业祭出投资限制措施。欧洲与日本等地亦透过政府计画推动量子研究。

一旦有人建成可以运行Shor算法(可破解RSA 加密的演算法)的大型量子电脑,绝大部分的传统加密方式都可能遭到破解。无论是网银交易、敏感军事报告、甚至私密讯息、虚拟货币钱包都可轻松破解。最恐怖的是,当破解方式一旦确立,不见得会以剧烈的全球大恐慌呈现,更可能以在暗处以潜伏的方式、进行资料窃取与关键基础设施的定向攻击,也可能一举释出庞大资料造成全面恐慌。这种威胁促使像美国国家标准技术研究院(NIST)等机构致力推动「后量子加密演算法」标准化,包含利用高维度晶格或其他量子难解问题为新加密基础。若企业与政府无法及时换用抗量子密码,将面临庞大风险。

也有阴谋论说,许多国家级单位或许早就在秘密搜集大量加密资料,等待量子电脑成熟后再集中破解,导致资讯安全出现「现在拦截、未来解密」的严峻局面。美国海军战争学院前教授Chris Demchak 的分析就指出,一旦对手能即时破解军事通讯,可能在潜艇部署、卫星监控、飞弹配置等核心领域掌握致命优势。甚至连比特币区块链也可能一夕崩溃,因为现行的椭圆曲线加密遭量子电脑攻破后,恶意分子可盗领持有者的加密资产。

挑战与现实限制

量子AI 要飞跃性成长并不容易,硬体是最大瓶颈。一般电脑资料是用0 和1 位元存储,位元很稳定,弄错机率很低。但量子电脑是叠加态量子位元(qubit),它们很特别,能同时是0 和1,还能跟其他量子位元纠缠。问题是,量子位元超级敏感,外界一点小干扰,比如温度变化、磁场抖动、甚至旁边有个电子乱跑,都可能让资料失去原本的状态不准确,就叫「去相干」(decoherence),导致运算结果错得乱七八糟,所以需要「纠错」救场,纠错就是用好几个量子位元「保护」一个重要量子位元,资讯分散出去,这样就算有几个坏掉,还能用剩下的拼回来。

这种技术叫「量子误差修正码」(quantum error-correcting code)。比如有名的「Shor 码」,是用九个量子位元保护一个,让错误率降至可接受范围。但这也有代价,多了「备份」,量子电脑需要的量子位元数量就得多好几倍,控制起来也更麻烦。

目前量子处理器仅有数十到数百个量子位元,且属「噪声中等规模量子」(NISQ)装置,未能实现纠错。专家估计,实用AI应用需上百万个稳定量子位元,但打造如此规模的设备在物理和工程极为困难──量子位元极脆弱,需在接近绝对零度的环境下运作,扩展性受限。 Google 的Julian Kelly 预估五年内可能有初步应用,IBM 计划2029 年前推出数百个纠错量子位元系统,但多数学者认为大规模应用还需十年以上。

飞跃的希望还是炒作多于现实?

量子电脑的问题除了技术,还有实现难度与瓶颈:NVIDIA 2025 GTC 宣布要盖量子运算研究室,显示业界对量子运算信心满满,Quantum Day 让股票如D-Wave Quantum 活动期间上涨9.4%;不少大企业的量子实验、论文、强化学习成果都能为量子AI 的可行性背书。技术成熟会大幅缩短训练模型的时间、各大AI 应用领域也将有显著进步。

但当前量子AI 相关研究多为实验室展示、缺乏商用应用,且硬体稳定性不足以支撑大规模AI 模型,且加密破解风险也令人担忧,Wired 报导指出,Shor 演算法若实现,可能让RSA 加密崩溃,冲击金融与隐私安全。有预估2035 年之前,会有三分之一机率让量子电脑有重大突破,但现阶段看来的量子AI 难以有立即的可行性发展。

不过量子研究的确是全球重点项目,中国以举国体制投入、美国透过国家量子倡议法参与,企业如Google、IBM、微软等大公司也积极布局。欧盟也有持续投入数亿欧元的量子旗舰计画。未来随着量子位元规模提升、得以在特定领域实现纠错时,少数领域可能率先应用量子AI。但要全面改变AI 格局的时间还难以预测,在此之前,量子位元结合传统硬体的运算方式可能成为过渡方案。