《黑镜》、《心灵判官》剧情要成真?英国司法部秘密进行「杀人预测计划」,利用AI分析个人资料预测潜在杀人犯,引发伦理争议。

英国秘密研究杀人犯预测系统,《心灵判官》动画剧情要成真?

在日本动画《PSYCHO-PASS 心灵判官》中,有一个名为「希贝儿先知系统」的强大监测网路,能够主动扫描市民的心智与精神状态,计算出所谓的「心灵指数」与「犯罪指数」,预测一个人犯罪的可能性。

如果指标超过门槛值,即使尚未犯案,此人也会被警方追捕甚至就地处决。

日本动画《PSYCHO-PASS心灵判官》,有一个希贝儿先知系统可计算市民犯罪指数。

像这样反乌托邦式的科幻设定,在虚构的影视中时常被采用,例如《黑镜》、《关键报告》以及上述的《心灵判官》等。但随着科技持续进步,仰赖AI 进行社会安全管理的未来,或许真的快要到来?

非营利研究机构Statewatch 日前揭露的政府文件显示,英国司法部正在秘密进行一项「杀人预测计画」(Homicide Prediction Project),企图通过分析大量个人资料,预测哪些人可能会在未来犯下谋杀罪行。

英国杀人预测计画是什么?如何靠AI判断杀人倾向?

Statewatch 透过资讯自由法,获取一份政府文件,得知英国正在推动「杀人预测计画」,这是由首相办公室委托,是英国司法部、内政部、大曼彻斯特警察局以及伦敦大都会警察局共同合作的计画。

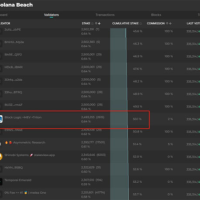

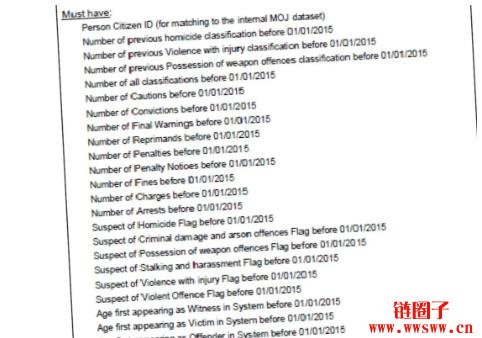

这个杀人预测系统使用英国司法部、警察国家电脑系统以及大曼彻斯特警察局的资料进行所谓的「杀人风险评估」,大曼彻斯特警察局已向该计画提供了10 万至50 万人的个人资料。

大曼彻斯特警方提供的资料,包含嫌疑人、受害者、目击者、失踪人口,以及有安全顾虑者的资讯。

英国秘密研究杀人犯预测系统,警察局与司法部共享50万人个资。

英国司法部表示,健康标记数据预期具有显著的预测力,这些资料还涉及人们的心理健康、成瘾情况、自我伤害、自杀、脆弱性和残疾等敏感资讯。

研究文件透露,司法部数据科学团队会「开发模型」,寻找资料中强大的杀人风险预测因子,并提及这个犯罪预测系统未来可能会开始运作。

用AI预测杀人犯,真的没问题吗?

用犯罪预测系统来判断某人是否会犯罪,是非常容易引发道德批判的尝试。

Statewatch 研究员Sofia Lyall 也对此表示「毛骨悚然」且「反乌托邦」。但更令人担忧的是,透过AI 演算法打造的犯罪预测系统,会让即使尚未犯罪的人也可能被系统评为「高风险」,并遭受不必要的监控:

「研究多次表明,用于预测犯罪的演算法系统本身有缺陷。然而,政府却在大力推动AI 系统,该系统能够在人们做出任何行为之前就将其定性为罪犯。」

司法部自己进行的研究发现,再犯罪预测工具「罪犯评估系统」(OASys)对黑人罪犯的预测准确度低于白人罪犯,但目前这项系统已被用于量刑决定、监狱分类和假释决定。

Lyall 批判,利用英国带有制度性种族歧视的警察及内政部数据的模型,将强化并放大刑事法律系统中的结构性歧视,而使用有关心理健康、成瘾和残疾的敏感数据,更是极度侵犯人民的隐私。

AI监视社会将至?研究员呼吁:立刻停止研究杀人预测!

目前,英国秘密研究的犯罪预测系统虽仍处于研究阶段,但随着AI 技术的发展,政府必须思考如何在预防犯罪,与保护公民隐私和自由之间取得平衡。

从伦理道德的角度来看,将某个人打上「潜在杀人犯」的标签,可能造成难以抚平的社会烙印,尤其目前的预测技术仍然有偏见和不准确的情形。

当犯罪难以避免,但政府在消减社会福利同时,还妄想能用科技解决一切时,可能会出现治标不治本的问题。

Statewatch 研究员就呼吁:

「英国司法部必须立即停止进一步发展杀人预测工具。政府不应花钱开发有问题且带有种族歧视的AI 和演算法,而应投资于真正有支持性的社会福利服务。」

如果透过AI 监视社会的未来成真,那么《PSYCHO-PASS 心灵判官》的剧情,可能将成为一种惊悚的未来预言。

随着《卫报》等主流媒体对这份研究进行报导,公众讨论已经展开,人们开始思考:「当科幻小说和动画中的情节逐渐走入现实,我们的社会准备好了吗?」而在被系统长期控制的社会中,人们的自由与选择权又该如何被维护?